En ce moment

- One Piece Épisode 1101 : Date et heure de sortie officielle en streaming !

- Ces pirates d’anime et manga vont devoir payer la somme la plus colossale jamais encourue au Japon !

- One Piece Chapitre 1112 : Date et heure de sortie officiellement prévue !

- L’anime de Boruto nous montrait déjà les pouvoirs d’Himawari dans ces scènes !

- La confession d’Eiichiro Oda envers l’oeuvre d’Akira Toriyama ferme ce débat des fans !

- La suite des Spoilers du Chapitre 1112 de One Piece !

Le meilleur de l’Anime

- One Piece Épisode 1101 : Date et heure de sortie officielle en streaming !

- La confession d’Eiichiro Oda envers l’oeuvre d’Akira Toriyama ferme ce débat des fans !

- One Piece dévoile son tout dernier trailer ! (vidéo)

- Hiruzen Sarutobi : Vous allez l’haïr encore plus en sachant ça

- Le Saiyan le plus rare vient prouver que Broly est Légendaire !

- Le membre le plus fort de l’Akatsuki, c’est officiellement lui !

- « Encore mieux que Marineford » : Une promesse d’Eiichiro Oda pour la suite de One Piece !

- Il est tellement sous-côté ! Comment Boruto n’est pas vu à sa juste valeur ? Voilà ce qu’il propose pourtant

- [VIDEO] L’Ultra Ego affronte enfin l’Ultra Instinct dans Dragon Ball Super !

Le meilleur du Manga

- Ces pirates d’anime et manga vont devoir payer la somme la plus colossale jamais encourue au Japon !

- One Piece Chapitre 1112 : Date et heure de sortie officiellement prévue !

- L’anime de Boruto nous montrait déjà les pouvoirs d’Himawari dans ces scènes !

- La suite des Spoilers du Chapitre 1112 de One Piece !

- Boruto Chapitre 9 de Two Blue Vortex : (spoilers) ! Nous y sommes enfin, après tout ce temps

- La suite de Dragon Ball Super : Broly et Gohan sous les feux de la rampe !

- Le Créateur de Naruto débarque en France ! Quand et où pouvez-vous le rencontrer ?

- Le Retour de Naruto en mode Baryon ! Mais la seule conditions, il semblerait que ce soit c’est celle-ci

- One Piece Netflix Saison 2 : La nouveauté annoncée pour la prochaine saison !

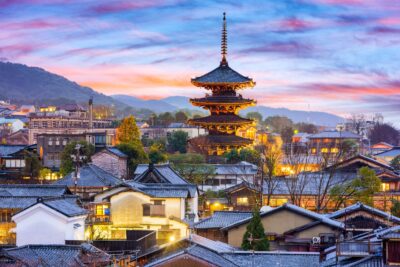

Voyager au Japon

La Culture Japonaise

- Qu’il y aura-t-il à la Japan Expo 2024 ? On vous raconte en détails !

- TOP 10 des Choses à absolument connaître ou vivre au Japon !

- Impossible de passer à côté : Le Japon vous propose ces 10 expériences incontournables !

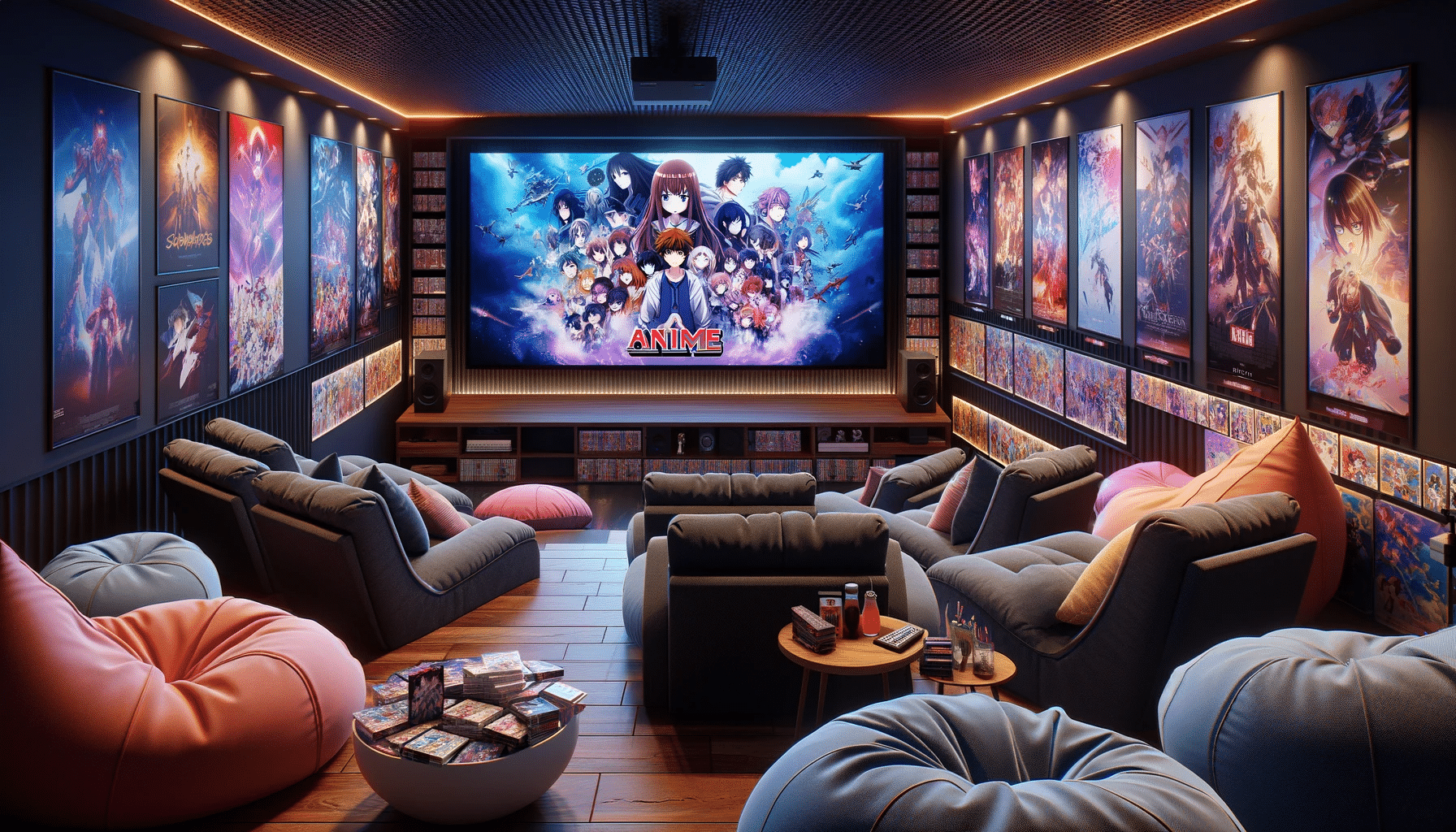

- Comment créer un cinéma à domicile pour regarder ses animes préférés ?

- Découvrez les 10 marques de montres japonaises les plus populaires

- 10 indispensables pour une décoration japonaise réussie